MADRID, 5 (Portaltic/EP)

Google ha presentado PaLM (Pathways Language Model), su nuevo modelo de lenguaje que es capaz de programar, resolver problemas matemáticos y explicar chistes con un porcentaje de eficiencia en el aprendizaje que le sitúan por encima de otros modelos de lenguaje creados hasta la fecha.

Google explica que PaLM ha sido entrenado con el modelo Pathways, que le ha permitido entrenar de forma eficiente un solo modelo con múltiples unidades de procesamiento tensorial (TPU) Pods, como recoge en un comunicado publicado en su blog. Se basa en el aprendizaje de ‘pocos disparos’, que reduce la cantidad de ejemplos necesarios en el entrenamiento con tareas específicas para adaptarlo a una sola aplicación.

Para ello, se ha usado una base de datos con 780.000 millones de tokens, que combina «un conjunto de datos multilingües» además de en inglés, que incluyen documentos web, libros, Wikipedia, conversaciones y código GitHub. También un vocabulario ‘sin pérdidas’ que «preserva todos los espacios en blanco», algo que se señala como «especialmente importante» para programar, y la divisón de los caracteres de Unicode que no se encuentran en el vocabulario en bytes.

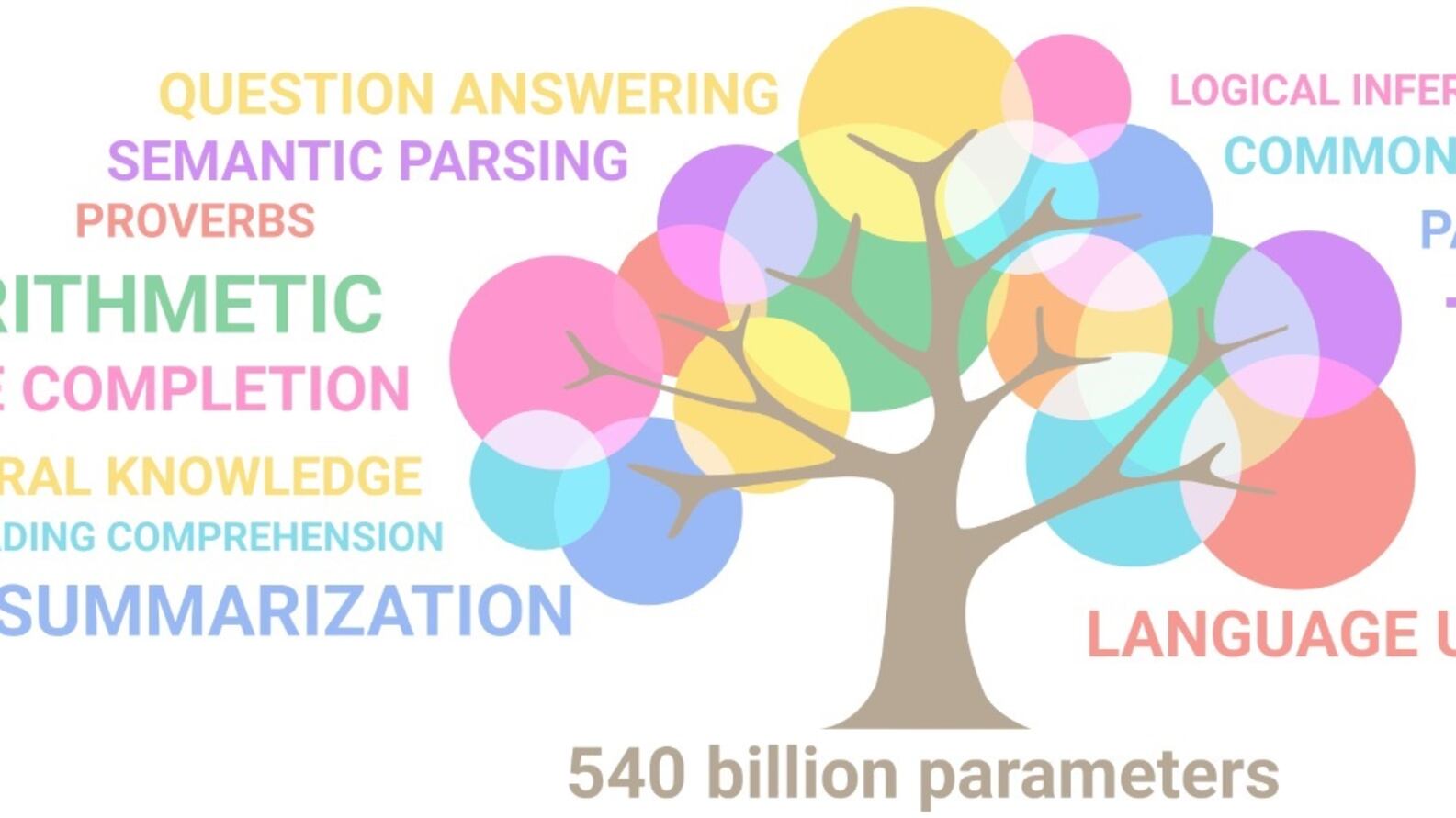

Esta nueva IA alberga 540.000 millones de parámetros, cifra que supera los 175.000 millones del GPT-3 de OpenAI, el modelo de lenguaje que Google cita como pionero en mostrar que estos pueden ser usados para el aprendizaje con «impresionantes resultados».

El nuevo modelo de lenguaje de Google combina 6.144 TPU v4 chips en Pathways, «la mayor configuración de TPU» utilizada de la historia, según ha destacado la compañía. PaLM alcanza además una eficiencia en el entrenamiento del 57,8% en el uso de flops en ‘hardware’, «la más alta alcanzada hasta ahora para los modelos de lenguaje a esta escala».

Esto es posible gracias a la combinación de «la estrategia del paralelismo y una reformulación del bloque transformador» que permite a las capas de atención y avance ser computadas en paralelo, acelerando así «las optimizaciones del compilador TPU».

«PaLM ha demostrado capacidades innovadoras en numerosas y muy difíciles tareas», afirma la tecnológica, que ha expuesto varios ejemplos que van desde la comprensión y generación del lenguaje al razonamiento y tareas relacionadas con la programación.

Una de las pruebas que Google pone como ejemplo consiste en pedir a PaLM que adivine una película basándose en cuatro emojis: un robot, un insecto, una planta y el planeta Tierra. De entre todas las opciones (L.A. Confidential, Wall-E, León: el profesional, BIG y Rush), la IA elige la correcta: Wall-E.

En otra, se le pide elegir de entre una lista de palabras dos que estén asociadas a ‘tropiezo’ (stumble) y también acierta al seleccionar ‘caída’ (fall) y ‘traspié’ (trip).

La IA es también capaz de resolver problemas matemáticos sencillos y hasta de explicar un chiste contextualizando y desgranando los elementos que aparecen en el mismo para darle sentido.

Por último, Google también señala que PaLM es capaz de programar traduciendo un código «de un lenguaje a otro», escribiendo código en base a «una descripción natural del lenguaje» y «solucionar errores de compilación».